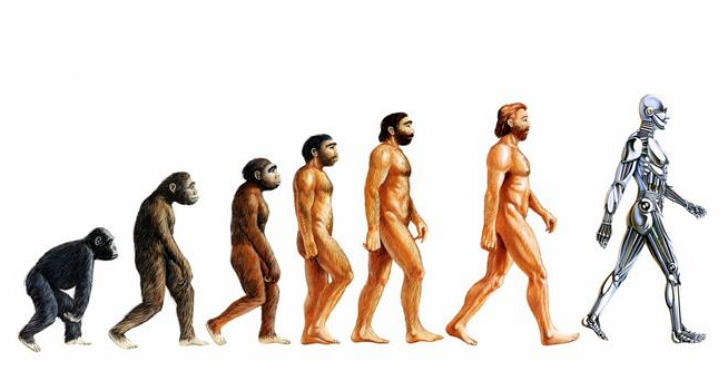

過去提到機器人,一定都會講到科幻作家艾西莫夫的「機器人三大法則」,這三大法則不僅對於科幻小說有相當的影響,甚至在日本的機器人工業,也都會提到這個法則。不過,隨著現在機器人技術越來越進步,AI人工智慧進化,AlphaGo可以擊敗人類圍棋棋手,FB所看的東西也由演算法決定,人類先要面臨的議題就是如何與演算法共存。

微軟 CEO Satya Nadella 就此發表了一篇文章,他認為人類在 AI 方面必須展開更深入的協調和協作,就設計的倫理和移情框架達成一致。為此他提出了人工智慧需要遵循的六大原則,以及未來人類要想不被時代拋棄需要堅持和發展的四個東西。Nadella 認為,未來的 AI 世界人和機器的關係不是非此即彼,而應該是人機攜手,共創未來。以下為該文的摘要:

人機攜手之美已經在 AI 是好還是壞的討論中迷失。我們對 AI 的看法似乎已經陷入到兩種聲音之間:一種是科幻片《2001 太空漫遊》 裡面 HAL 令人不安的環境音,一種是今天的 Cortana、Siri 以及 Alexa 等個人語音助手友善的提示聲。我們可以讓機器開車送我們、替我們幹雜務、幫助我們做出更好決策的時候做著如何利用空閒時間的白日夢。

在我看來,最具建設性的討論未必是 AI 的正邪之爭:爭論的焦點應該放在該技術給人和創造者帶來的價值上面。在《與機器人共舞(Machines of Loving Grace)》一書中,John Markoff 寫道:「回答充斥著智慧機器的世界的控制這個難題的最好辦法,是理解創造這些系統的人的價值。」 這是一個有趣的問題,必須由整個科技業一起討論。

今年早些時候,我在一場開發者會議上分享了我們對 AI 的看法。首先我們希望開發能夠增強人類能力和體驗的智慧,最終這不會是人類 vs 機器的一場對決。

人類有創造力、同理心、情感、肉體性以及洞察力,這些東西可以跟強大的 AI 融合到一起。運算,也就是透過大數據獲得理性以及更快進行模式識別的能力,可以幫助推動社會前進。其次,我們還必須把信任直接建立到技術裡面。我們必須針對隱私、透明和安全給技術增加防護。AI 裝置必須設計用於檢測新威脅,並且隨著 AI 的演變來設計出相應的防護。第三,我們開發的所有技術都必須包容所有人、尊重所有人。

這只是開始,我們還可以走得更遠,而技術界不應該決定這一未來的價值觀和美德。

機器人三大法則

科幻小說家艾西莫夫給了一個很好的起點,儘管還不夠充分:他在 1940年 代提出了 「機器人三大法則」 作為故事當中機器人的倫理守則。

艾西莫夫定律是層次化的,即第一原則高於第二原則,第二原則高於第三原則。

- 第一原則是機器人不得傷害人類,或看到人類受到傷害而袖手旁觀;

- 第二原則是機器人必須服從人類的命令,除非這條命令與第一條相矛盾;

- 第三原則是機器人必須保護自己,除非這種保護與以上兩條相矛盾。

儘管艾西莫夫定律作為策略而言比較方便且具有啟發性,但是並沒有提供研究人員和技術公司可以遵循的價值觀或者設計原則,也沒有告訴社會當 AI 和機器學習對經濟越來越多的構成產生推動時,人類必須帶入這下一個時代的能力是什麼。

科技界的先驅 Alan Kay 揶揄道:「預測未來的最好辦法是創造未來。」 在 AI 的背景下,他的意思是說不要再預測未來的樣子,用有原則的方式去創造未來才是正道。

我同意。就像任何軟體工具挑戰一樣,原則做法始於開發的平台基礎。AI 正在成為下一個平台。過去我們為 PC 編寫 Word、PowerPoint 之類的 Office 應用程式。現在的 Office 365 包含了 Office、Skype 和 Outlook,是寫給 web 的。而在 AI 和機器人的世界裡,這些生產力和溝通工具將會針對一個全新的平台編寫,這個平台不僅管理訊息還會從訊息中學習並且與物理世界互動。

MIT Media Lab 的 Cynthia Breazeal 把一生都奉獻給了探索更人性化的人工智慧和機器人上面。她提出,技術往往忽視了設計的社會和行為因素。Cynthia 在最近的談話中說我們是所有物種當中最社會化和最富有感情的一種,但是在技術設計中卻幾乎沒有考慮過移情的問題。

她說:「我們畢竟是透過溝通和協作來體驗 世界的。如果我們對一起協作的機器感興趣,那就不能忽視人性化方法。」

AI發展的六大法則

為此,我思考了一些我們作為行業和社會應該共同討論和辯論的原則和目標。

1、AI 必須用來輔助人類:隨著我們開發出來的自動機器越來越多,我們需要尊重人類自治。協作式機器人(co-bots)應當從事採礦之類的危險工作,從而為人類豎起一道安全網和提供保護措施。

2、AI 必須是透明的: 人類應該要知道技術是如何運作的,它的規則是什麼。我們需要的不僅僅是智慧機器(intelligent machines),而且是可理解的機器(intelligible machines)。技術會瞭解人類的事情,但是人類也必須瞭解機器的事情。大家應該對技術如何審視和分析世界有瞭解。倫理和設計必須齊頭並進。

3、AI 必須實現效能最大化,同時又不能傷害人的尊嚴:它應該維護文化承諾,支援多樣化。在設計這些系統時我們需要有更廣泛更深入更多的各種互動。技術界不應該決定這個未來的價值觀和美德。

4、AI 必須用於智慧隱私:要有複雜的手段保護個人以及群體訊息,要能夠以增進信任的方式進行。

5、AI 必須承擔算法責任以便人類可以撤銷非故意的傷害。我們設計這些技術時必須考慮到預期和非預期的情況。

6、AI 必須防止偏見,確保進行適當的、有代表性的調查,從而防止錯誤的啟發法不會造成歧視。

人類與AI共存的四點法則

人類也必須遵守一些法則—尤其是在考慮清楚我們的後代必須考慮和培養哪些技能方面。為了不被時代拋棄,我們的孩子和他們的孩子需要有:

7、同理心—機器很難複製的同理心(Empathy)在人與 AI 共存的世界裡非常有價值。感覺到別人的想法和感受,協作和建立關係將會變得至關重要。

8、教育— 有人提出,因為壽命延長出生率會下降,因為在教育的投入也會降低。但我認為要想進行創新並管理好我們今天看不清楚的創新,我們就必須不斷加大對教育的投資 才能拔高我們的思考層次,才能獲得更加公平的教育產出。

新技術大規模實施所需的知識掌握和技能培養是一個非常困難的社會問題,要花很長時間才能解決。動力紡織機器在 1810年 就發明出來了,但是由於經過充分培訓的技工人手不足,服裝業完成革新卻花了 35年 的時間。

9、創造力— 創造力是最夢寐以求的人類技能之一,這一點不會改變。機器會繼續豐富和增強我們的創造力。小說家 Jhumpa Lahiri 最近在接受採訪中被問到,作為有特殊影響力的英國文學作家,為何要用自己的第三語言意大利語來進行新的文學創作?她說道:「不斷探索難道不就是創造力的要點 嗎?」

10、裁決和責任—我們也許願意接受一個電腦產生的診斷書或者法律判決,但我們更希望由人來最後對結果負責。

你會服從電腦的決定嗎?

AI 的發展和對社會的影響才剛剛開始。要想真正把握即將到來的這個時代的意義需要進行深入的、多方面的分析。

我在微軟研究院的同事 Eric Horvitz 是人工智慧領域的先驅,他一直在問自己這些問題。Eric 和他的家人為斯坦福大學的 One Hundred Year Study 研究計劃提供了資助。該計畫將在下一世紀來臨前的每一年,就智慧運算的崛起、對機器智慧認知的變化,以及人際關係的可能改變會引發的近期和遠期社會經濟 學、法律和道德問題進行報告。

儘管未來沒有清晰的路線圖,但是之前的工業革命我們已經看到過渡期並不是一帆風順,要經歷一系列階段。

- 首先,我們發明和設計了變革的技術,也就是我們現在走到的地方。

- 接著,我們面向未來轉型。比方說,無人機飛行員需要培訓;舊車的方向盤需要卸掉,因為會被改成無人車。

- 第三,我們要對畸變、不協調以及錯位進行引導。

當利用機器看 X 光片的判斷水準更進化之後,放射科醫生的工作是什麼?當電腦可以從上百萬份資料當中找出無人可以識別的模式之後,律師的職責又是什麼呢?但是,如果我們能夠吸收 適的價值觀和設計原則,如果我們能夠準備好作為人類的必備技能的話,人類和社會就能繼續繁榮。

- 本文編譯自:slate.com

不管是發展6大法則還是共存4大法則,聽起來就像政客會用語言,

裡面用了一堆形容詞跟難以界定的概念名詞,

我覺得別說機器人要照這個發展,光是人要執行都會被繞暈了