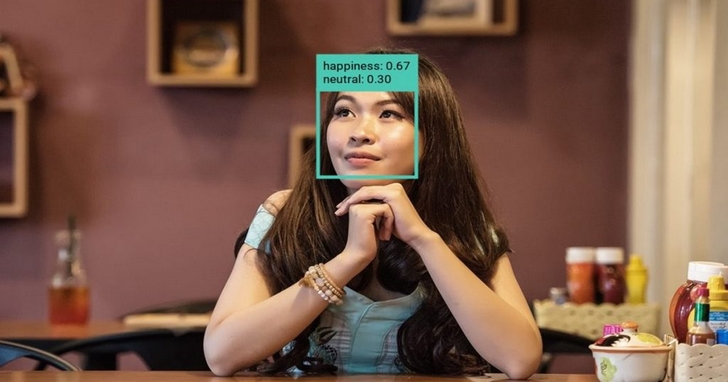

在中國演唱會「抓逃犯」上屢建奇功的人臉識別,其實還是不成熟的技術,尤其在判別時,反應出對於對膚色和性別歧視。微軟發現,商用人臉識別在判別膚色較淺的男性準確率最高,而失誤率最嚴重的是膚色較深的女性。這可算是人臉辨識的「 技術偏見 」了。但這種偏見一旦在大範圍應用中「顯現」,聲討種族和性別「歧視」的聲音,將會淹沒微軟。

為了解決充滿偏見的技術,微軟Face API團隊對其識別系統進行了三次重大改進。最新的人臉辨識系統,識別膚色較深的人錯誤率降低了20倍,識別所有女性的失誤率減低了9倍。

儘管有了改進,但目前的人臉辨識還不是完美的系統。微軟認為,問題的根本解決辦法還是訓練資料庫,需要收集更多的資料,包括不同膚色、髮型和臉部的飾品等。

東方人普遍的黃皮膚,剛好避開了「最淺」和「最深」的膚色。但像各國也有外貌特徵各異的少數民族,如果人臉辨識對此產生技術偏見,就不是簡單的「開地圖炮」了,可能會引發嚴重的民族矛盾。至於「更大範圍攻擊」的性別歧視話題,在許多國家也非常敏感,該慶幸人臉辨識技術目前還沒有惹來「性別歧視罵戰」。

東方人普遍的黃皮膚,剛好避開了「最淺」和「最深」的膚色。但像各國也有外貌特徵各異的少數民族,如果人臉辨識對此產生技術偏見,就不是簡單的「開地圖炮」了,可能會引發嚴重的民族矛盾。至於「更大範圍攻擊」的性別歧視話題,在許多國家也非常敏感,該慶幸人臉辨識技術目前還沒有惹來「性別歧視罵戰」。

這種偏見不能完全推給人工智慧,技術也是反映真實社會的鏡子。微軟研究實驗室的高級研究員、AI系統公平性專家Hanna Wallach 在一份聲明中回應:

如果我們訓練機器學習系統使用有偏見的社會產生的資料,來模擬那個社會做出決定,那麼這些系統必然會重現它的偏見。

例如,在一些社區中,黑人的犯罪率更高,AI 根據收集來的資料,更容易把膚色較深的人劃分到「逃犯」的分類中。這是群體給個體的傷害,人臉辨識只不過「遵循了」社會偏見。

相比起導致「歧視」,研究團隊更希望AI 能檢測和減輕偏見,以彌補現實社會中的不完美。追捕逃犯用大範圍攻擊的「種族炮」和「性別炮」容易傷及無辜,人臉辨識的方向是更精密的「狙擊槍」。一直對人臉辨識技術保持警惕的美國,其海關部門也要啟用人臉辨識系統,但受到強烈的反對。

關於人臉辨識,最近亞馬遜的狀況也很多,先是美國公民自由聯盟向亞馬遜提交請願信,接著100多名內部員工也要求首席執行長Jeff Bezos 停止向美國警方出售人臉辨識軟體。目前,美國奧蘭多市警察局與亞馬遜的人臉辨識合約已過期,雙方還沒決定續約。

「亞馬遜人」 簽署的部分內容:

我們公司不應該在監控業務中; 我們不應該參與警務工作; 我們不應該從事支持監督和壓迫邊緣化人群的人。

儘管微軟員工與亞馬遜員工的想法一致,堅決認為人臉辨識軟體侵犯人權,對美國最近的移民政策尤其不滿,希望微軟CEO Satya Nadella停止與ICE (美國移民及海關執法局) 簽署協議,但目前仍沒收到成效。

人臉辨識技術到底帶來了安全保障,還是帶來了歧視,侵犯了個人自由?美國科技公司們的「糾結」,也許值得讓人思考,看演唱會被人臉辨識,到底是不是妥當的?(本文授權轉載自愛範兒)

請注意!留言要自負法律責任,相關案例層出不窮,請慎重發文!