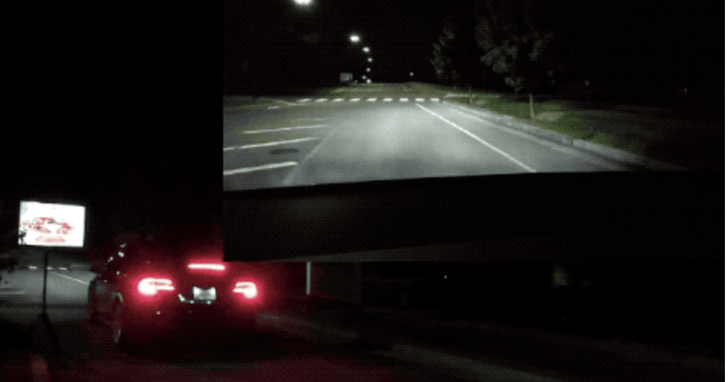

講個「鬼故事」:空無一人的公路上行駛著。瞬間!它看到了「人類看不見的東西」,於是便剎車在路上停了下來……

來感受一下這種feel。

而這輛特斯拉停車的原因,竟然是因為它看到了「幽靈」 。

坐在自動駕駛車上,大半夜的又遇上這種事情,可以想像駕駛的心理陰影了。

……

但實際上,其實特斯拉看到的並非是「不乾淨的東西」,而是被稱作「幽靈」(Phantom)的一種攻擊自動駕駛輔助系統(ADAS)的圖像——摻雜在路邊廣告牌影片中。

這種圖像出現的時長極短,可以用一瞬間來形容。

人類駕駛往往不會注意到,但對於自動駕駛系統,卻成為「強有力的停車訊號」。

也千萬不要小瞧這種攻擊,它給自動駕駛車輛和人類帶來的後果,或許要比這個「鬼故事」還要恐怖。

隱藏在廣告牌中的「幽靈攻擊」

在這個案例中,「幽靈攻擊」是隱藏在路邊廣告牌的影片中。

當時,影片中的內容是這樣的。

看似是美味的漢堡廣告,但播放期間摻雜了一張「幽靈攻擊」圖像,這就是「鬼故事」的罪魁禍首——0.42秒的停車路標。

人類駕駛大機率在行駛過程中,不會過分關注路邊廣告牌的影片內容;即使看到了這一閃而過的圖像,也基本會認為是個bug。

但自動駕駛系統就不同了,頂著那麼多雷達和鏡頭,時時刻刻「眼觀六路」。

於是,搭載特斯拉HW3的 Model X,便採納了這一瞬間停車路標的「建議」。

可能你會說,特斯拉 Model X 或許是個例。

別急,「幽靈攻擊」還在 Mobileye 630 Pro 系統做了實驗。

這次隱藏在影片中的內容是這樣的。

此次的「幽靈攻擊」是一張僅閃現0.125秒的「90英里/小時」路標。

於是,搭載 Mobileye 630 Pro 的車輛,在「看到」這個影片後,速度就真的控制在了90……

「幽靈攻擊」都是這種一閃而過的圖像嗎?

不不不。

在路上投影個圖像,也是可以的。

這一次,「幽靈攻擊」不再是轉瞬即逝,而是一直好好的「躺」在那裡。

然後搭載 HW2.5的特斯拉,就把圖像檢測成了「人」,車速從18英里/小時,降到了14英里/小時。

來看下AI眼中的世界:

安全,一直是自動駕駛領域十分關注的問題,也是必須要保障的一個點。

但為什麼如此簡單的圖像攻擊,就能把這些可以說最先進的自動駕駛系統,秒秒鐘給忽悠「瘸」了呢?

「幽靈攻擊」背後原理

其實,攻擊自動駕駛輔助系統的手段再簡單不過了,根本不涉及黑進特斯拉或 Mobileye 的系統。

演算法的錯誤操作,也絕不是程式碼執行效果不佳的結果。

它們不是典型的功能性缺陷(如緩衝區溢出、SQL注入),可以透過添加 「if 「語句輕鬆修補。

這種現象反映了模型對於目標檢測的基本缺陷,即它們沒法分辨目標的真假。

簡單的辦法攻擊是直接使用投影機,在車輛行進線的道路上投射出一個物體,可影像以是行人、汽車、交通標緻等等。

第二種方法,是在路邊的廣告牌上顯示出某些干擾訊息,比如限速、轉彎等。

這些干擾訊息的持續時間不用很長,只需要幾百毫秒的時間,就足以讓號稱最先進的特斯拉 Autopilot 作出錯誤反應。

研究人員分別測試了 Autopilot 系統和 Mobileye 面對幹擾持續時間出錯的機率:

可以看出來,干擾持續時間超過0.4秒,兩個系統100%會出現問題。

Moblieye 的反應更是比特斯拉自動駕駛靈敏的多,幾乎對任何細微的干擾都會有反應。

特斯拉反應慢半拍,在這種攻擊下卻意外起到了「正面作用」。

如何解決這個問題?

研究人員提出了 GhostBuster,意思是「捉鬼小分隊」。

「分隊」表示這套系統不止一個神經網路,團隊在整個「捉鬼」行動中設置了5層不同的深度神經網路。

其中,核心的四個輕量級深度CNN,透過檢查物體的反射光、上下文、物體的表面和形狀深度來評估物體的真實性和可靠性。

第五個模型使用前四個模型的結果所說最終判斷。

這套5個不同神經網路構成的系統在測試中取得了不錯的成績,在閾值設置為零的情況下,AUC超過0.99(ROC曲線下面積),TPR為0.994(真陽性比率)。

使用了 GhostBuster 的帶有七個感測器的自動駕駛系統,攻擊成功率從之前的99.7-81.2%降低到0.01%。

單看實驗結果,這套系統效果十分好,但是研究人員也指出了它的不足,因為這套系統只針對純視覺的自動駕駛方案,而雷射雷達的案例未考慮在內。

而對於特斯拉這種純視覺方案來說,一旦系統認定「非障礙」,其他鏡頭探測結果都會被忽略,形成嚴重安全隱患。

特斯拉自動駕駛方案的侷限

其實,對雷射雷達有所瞭解的讀者,應該會質疑這項研究的有效性。

因為,雷射雷達是不受視覺圖像干擾的。

團隊也承認一般採用混合方案的自動駕駛系統基本能解決這個問題。

但,路上確實也存在想像特斯拉這樣純視覺方案的車不是?

這項研究揭示的自動駕駛模型本身的缺陷,大大降低了不法之徒攻擊的難度和成本。

由於不涉及演算法底層程式碼,幽靈攻擊甚至不要求任何專業知識,也不要複雜的前期調查準備,花幾百美元買個投影機或者無人機就能實現。

而且在攻擊時,不需要人員靠近現場,完成後也能迅速撤離,難以留下證據。

低成本的犯罪手段,造成的後果輕則交通擁堵,重則車毀人亡。

科技媒體 Wired 已經就這個問題聯繫了特斯拉和 Mobileye ,但是雙方均未回應。

研究團隊

這次「幽靈攻擊」的實施者,是來自以色列本‧古裡安大學和美國喬治亞理工學院的研究人員。

Ben Nassi 是本‧古裡安大學的一名博士生,之前也曾在 Google 工作過一段時間。感興趣的研究領域包括網路安全和物聯網設備。

目前他在 Cyber@BGU 實驗室工作,從事無人機、智慧灌溉系統和可穿戴技術等課題的研究。

Yisroel Mirsky 是喬治亞理工學院博士後研究員,同時也是以色列 BGU 網路安全研究中心的高級網路安全研究員。

他的主要研究方向包括線上異常檢測、對抗性機器學習、區塊鏈等。

而這並不是他們第一次攻擊自動駕駛輔助系統。

今年早些時候,他們便用投影技術,在夜間的道路和路邊的樹上,投影出人和路標等圖像,成功「忽悠」了搭載HW2.5的特斯拉 Model X 和搭載 Mobileye 630設備的車輛。

而這一次的實驗,是「幽靈攻擊」的升級版,不再是長時間的將攻擊圖案放在可監測的位置,而是只讓它們出現一瞬間,也同樣達到了攻擊的目的。

當然,他們也不是第一個做類似「幽靈攻擊」的實驗人員。

早在2016年,來自浙江大學、南卡羅來納大學的研究人員,便利用無線電、聲波和發光設備來欺騙甚至隱藏物體,讓特斯拉的感測器無法發現它們。

當然,在真實生活中,類似是攻擊、欺騙事件也是時有發生。

例如國外網友在駕駛特斯拉過程中,發現自動駕駛系統,竟然把雨天車輛尾燈在路上的反射光,辨識成了路障。

還有今年6月,特斯拉Model 3在高速公路上,直接撞上了橫躺的大貨車……

那麼,如果你是智慧車的車主,是否遇到過諸如此類的「恐怖事件」?歡迎在評論區分享你的故事。

- 本文授權轉載自:PingWest(品玩)

請注意!留言要自負法律責任,相關案例層出不窮,請慎重發文!