上週,Google CFO Ruth Porat 公佈,Google 旗下的無人車項目 Waymo 已經開始商業化,其投放於美國亞利桑那州的自動駕駛汽車將於今年第三季度開始向乘客收取費用。

Google 於 2016 年開始在美國亞利桑那州試點無人駕駛項目,並從 2017 年開始突出 Early Rider 項目,為當地居民服務。過去這一年多來,Waymo 已經向當地 400 多名參與者提供了免費出行服務。如今,Waymo 認為他們已經準備好進入商用收費階段。

Google 於 2016 年開始在美國亞利桑那州試點無人駕駛項目,並從 2017 年開始突出 Early Rider 項目,為當地居民服務。過去這一年多來,Waymo 已經向當地 400 多名參與者提供了免費出行服務。如今,Waymo 認為他們已經準備好進入商用收費階段。

這預示著自動駕駛技術即將進入商業化時代,但我們真的準備好了嗎?答案可不一定。最致命的問題就是,我們似乎至今都沒想好,如果遇上車禍,自動駕駛汽車應該怎樣處理?

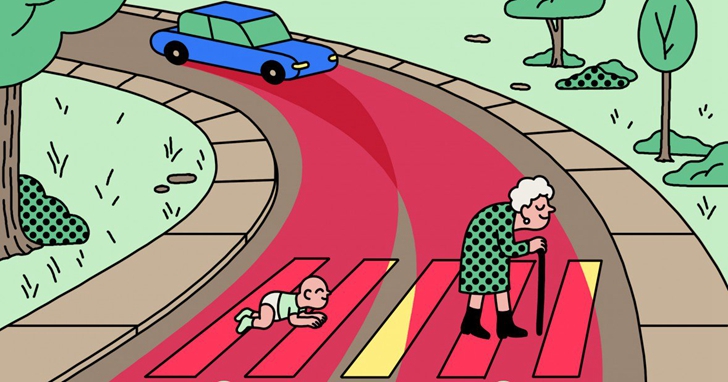

或者說,無人車發生車禍的時候,到底應該選擇救誰?

讓哲學家爭論了數十年未休的「電車難題」,現在,變得更難了。

「電車難題」最開始由英國哲學家菲力帕‧芙特提出,具體情景是:假如你看到一輛煞車壞了的電車,快要撞上軌道上的五個人,但你身邊有個按鈕,一按下去就能讓電車轉到備用軌道,但這裡也有一個人,那你是否應該犧牲在備用軌道上的一個人來救另外五個人?

如果你覺得這似乎不難決定,那如果原來軌道和備用軌道上都只有一個人,但一邊是老人家,而另一邊是一位小嬰兒呢?

4000 萬個決定:不同文化,不同選擇?

2014 年,MIT Media Lab 在網絡上發起了一項名為 Moral Machine 的實驗,讓世界各地的網友都能參與由「電車難題」衍生而來自動駕駛選擇題。譬如:選人還是寵物?男人還是女人?年輕人還是老人社會地位高的人還是低的人?普通路人還是闖了紅燈的人?

在過去幾年裡,超過 233 個國家和地區的數百萬名網友登錄這個網站,聯合做出了超過 4000 萬個決定,讓這個實驗成為了其中一個最大規模的全球性道德選擇類實驗。

但在問題設計上,Moral Machine 採用了疊加式選擇。譬如,讓你選,自動駕駛汽車是要救車裡的一名成年人和女孩,還是不換道,救下路上的一名老人家和寵物。透過一系列這種疊加式問題,研究總結出不同國家網友的選擇傾向。

中國和日本網友,更傾向於救老人家,而不是年輕人。其中,中國網友在這方面的傾向更是調查中最高的。研究者猜測,這可能和文化中注重敬老有關。

更強調個人主義的國家,如法國、英國和美國,則更傾向以可救到的人命數量來支持抉擇。對此,研究者猜測這和他們文化側重宣揚個人每個人所存在的意義有關。

不過,研究人員強調,這些資料不是用來指導未來的立法和設計的,而是為進一步討論提供基礎和啟發:我們應該將討論轉移到風險分析。我們應該去研究哪一方的風險更大,並研究其中歧視發生的情況。

當演算法負責做決定,責任又該誰來承擔?

MIT 研究指出,當面臨是救車裡的乘客還是路上行人時,各國同樣展示出不同的傾向。最偏向救路上行人的是日本的網友,尾隨其後的是挪威和新加坡的網友。而最偏向救車上乘客的,分別是中國、愛沙尼亞和法國等參與者。

這將我們引導到對自動駕駛汽車責任的討論。當我們將決策權放在演算法上,誰該為這個抉擇負責?

斯德哥爾摩大學實踐哲學教授 Helen Frowe 認為,那些坐在自動駕駛汽車裡的人對意外責任更大,所以汽車應該保護行人:

我們有嚴格義務不去殺人。如果你決定去坐一輛自動駕駛汽車,那就是在製造風險。

不過,Frowe 教授認為,車裡的兒童是無辜的。所以,當車裡的兒童數量增加,汽車傾向保護乘客的趨勢應逐漸增大。

顯然,有許多人會反對 Frowe 教授的看法,這就是道德選擇的問題,每個群體都不同觀點和選擇。

而麻州大學洛威爾分校的哲學教授 Nicholas Evans,就決定要窮盡每個選擇的可能性。Evans 於 2017 年獲得國家科學基金資助,用三年時間去創造一套演算法,展示在不同倫理理論下,自動駕駛汽車會怎樣應對各種各樣的「電車難題」變體。

Evans 自身並沒有站隊任何一種理論,他倒是希望能透過這個演算法,來幫助消費者或是汽車生產商創造一個有足夠訊息的環境,並希望他們能做出明智的選擇。

無論是針對醫學領域還是更廣泛的科學領域,一個好的實驗的標誌是,為參與者提供足夠訊息,並讓他們決定是否源於參與這個實驗。

希望,我們的研究資料能提供足夠訊息,好讓公眾做出明智決定,並得以對政客們。

真正在做自動駕駛的人怎麼說?

如果你覺得「電車難題」已經讓人頭痛不已,不好意思,我們得考慮的問題似乎還有更多。

例如,廠商是否可借自動駕駛汽車路線規劃,讓其可以經過廣告主的商店?如果汽車被駭客入侵導致傷害,誰將承擔責任?隱私問題又怎樣?

哲學教授 Patrick Lin 說,自動駕駛就像電力一樣,我們對它將造成的影響難以預測:

電力不只取代了蠟燭。電力驅動了許多事物的誕生,譬如家庭手工業和網絡生活。Ben Franklin 沒可能能預測到這些,沒人能。我覺得機器人和人工智能也屬於這個目錄。

與此同時,那些真正在塑造著自動駕駛系統的人,卻有不同看法。

從工程角度來看,解決「電車難題」並不是我們日常工作重心,原因有二:1. 我們不確定正確的答案是什麼,甚至有沒有答案都不好說;2. 這樣的事情發生的機率很小,去除了人類干預的無人駕駛理應更安全。

Karl Iagnemma 說道,他是 Aptiv Automated Mobility 的總裁兼自動駕駛汽車公司 nuTonomy 的聯合創始人。在他看來,我們仍處於第一波系統建設:

我們在全力研發安全且設計精良的系統。在第二波系統裡,也許我們才能開始將駕駛偏好、文化和地域差別融入系統中,到時,或者系統會將這些道德問題加進去吧。

而《紐約客》近期的一篇文章也指出,前 Google 工程師 Anthony Levandowski 此前在舊金山測試自動駕駛汽車 Waymo 項目時,違規將汽車開到了高速公路上,並釀成了車禍。

讓人感到意外的,Levandowski 在事後毫不關心車禍另一方司機的傷況,只是認為「這是無價的資料,是我們學習如何避免類似錯誤的機會」。

也許,這類討論我們還是越早開始越好。

- 本文授權轉載自愛範兒

請注意!留言要自負法律責任,相關案例層出不窮,請慎重發文!