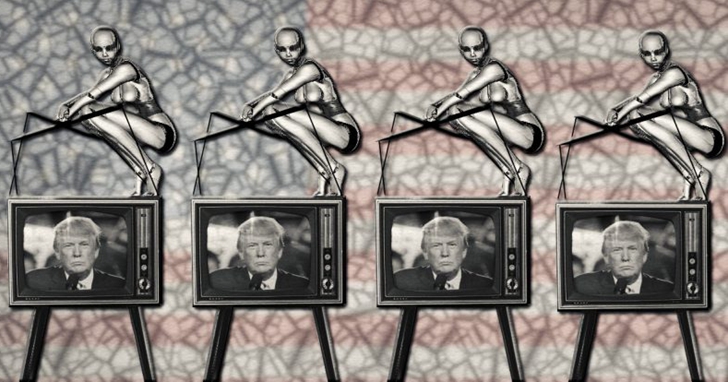

在下一屆選舉中,利用DeepFakes這種人工智慧技術所做出來的合成政治人物的假影片可能會很流行,這對民主來說絕對是個壞消息。

最近發布的一項研究表明,DeepFakes這種利用神經網路來製作出像是真人影片的技術,是人工智慧所造成的最大威脅之一。

最近發布的一項研究表明,DeepFakes這種利用神經網路來製作出像是真人影片的技術,是人工智慧所造成的最大威脅之一。

該研究的作者指出:

只要資料庫裡的語音訓練等數據夠多,人工智慧能夠製作出逼真的合作成語音,像是真人在講話一般,對於影片來說也是。在這篇文章發表的時間點,DeepFakes所偽造出來的聲音和影片,就算是個外行人也大概可以看出它的錯誤。但依照這些技術發展的速度來看,它們可能在5年之內就能騙過一般人的眼睛和耳朵。

如果之前你沒注意到deepfake,那我們告訴你,去年DeepFakes就因為把女明星的臉合成到色情影片上,而在社群媒體和色情網站中大受關注。 把音訊和影片利用電腦再處理並不是什麼新鮮事,大概十年前,我們在在銀幕上看到《創:光速戰記》(Tron Legacy)裡的傑夫·布里吉(Jeff Bridges),和他和35年前《電子世界爭霸戰》(Tron)裡演主角時的樣子也一模一樣。 這段時間改變的是什麼?使用deepfake非常容易,因為基本上困難的事情都可以由人工智慧來完成,使用者不需要什麼影片合成編輯的技巧,也不需要懂多少人工智慧的技術就可以使用——大多數deepfake這種合成造假的技術,都是由Google AI的開源平台TensorFlow所建構出來的。只要使用這些工具,任何人都可以用神經網路來建立和訓練deepfake,用以製作出一個以假亂真的假影片。 這就是為什麼去年deepfake剛出現時,人們感到既興奮又害怕。然後當它開始用來剝削女星剥削女明星時,人們開始對這種技術產生反感。 如果你沒看過歐巴馬羞辱川普的影片(當然,他沒有,這是假影片),那麼你真的應該花點時間看一下,這可以讓你對這個議題有些想法。

我估計在二年後即將到來的美國期中選舉和全國大選上,就可以看到這些偽造的影片內容。而因為這項技術是沒有國界之分的,所以這種影響將會波及全世界。

即使現在這些影片還不夠好,但我相信他們未來會變成更好。但就算是現在不夠好的影片,仍然可以欺騙夠多的人,讓這些人相信任何事情。不難想像,心懷惡意的人用AI來偽造政治人物的影片,讓他們的支持者分裂。 美國政府正在研究一種假影片的偵測器,而世界各地也有許多私人單位的研究人員在研發這些偵測工具。但是,永遠不會有一個無處不在的系統來保護所有人不看到這些偽造的影片,這意味著每一個受眾都需要保持警愓,因為這些假影片沒打算要說服人,只是要讓一些人的心裡開始產生懷疑就夠了。

資料來源:Experts warn DeepFakes could influence 2020 US election

最後,也只能說:Deepfake,幾乎不易辨識,以假亂真的移花接木技術,如果用來製作假訊息(及影片或短視頻)於特定時間不當散佈,不僅後果不堪設想,將是民主機制的浩劫。