也許圖靈測試要評估的並不是機器是否有智慧,而是我們是否願意接受它是智慧的。正如圖靈自己所說那樣:「智慧這個概念本身就是情感而不是運算。我們認為某個東西行為的智慧程度如何,既取決於我們自己的心理狀態與訓練情況,也取決於該對象的自身屬性,二者的決定程度是一樣的。」

1950年,數位時代即將開啟之際,艾倫·圖靈發表了他最著名的一篇論文,題目叫做《計算機器與智慧》,在裡面他提出了一個問題,「機器會思考嗎?」

圖靈並沒有試圖去定義「機器」和「智慧」這兩個詞,相反,他概述了回答這個問題的另一種辦法,這個辦法源自維多利亞時代的一種客廳消遣活動,名字叫做模仿遊戲。遊戲規則規定,一個男人和一個女人分別位於不同的房間,他們將透過手寫筆記與裁判進行溝通。裁判必須猜誰是誰,但他們的任務會有點複雜,因為那位男性在設法模仿女性。

在這種遊戲的啟發之下,圖靈構思了一個思想實驗,將其中一位選手換成了電腦。如果電腦在程式編輯之下能夠把這個遊戲玩得很流暢,以至於裁判無法斷定自己究竟是在跟人還是機器對話的話,圖靈提出,那就有理由推斷出機器是有智慧的。

這個思想實驗後來被稱為圖靈測試,至今仍是AI界最著名、引起爭議最大的想法之一。這個思想實驗吸引力的經久不衰,是在於它有望給一個充滿哲學意義的問題--「機器會思考嗎?」提供了一個不會模棱兩可的答案。如果電腦通過了圖靈測試,則答案就是肯定的。正如哲學家Daniel Dennett所寫那樣,圖靈測試本該是哲學對話的終結者。「與其無休止地爭論思考的終極本質和要義,我們為什麼不都就這一點達成一致呢?即無論其本質是什麼,任何東西只要通過了這一測試,當然就擁有思考能力。」

但是如果你再仔細看看圖靈的論文,你就會發現裡面有一個小細節其實給測試引入了模糊性,那個細節暗示,可能圖靈的意思更多的是有關機器智慧的一種哲學上的挑釁而不是實際測試。

在《計算機器與智慧》的一段裡面,圖靈模擬量對想像中未來的智慧型電腦測試可能的樣子。(人提出問題,電腦回答)

Q:請為我寫一首有關福斯橋(Forth Bridge)主題的十四行詩。

A:這種事情別找我。我從來都不會寫詩。

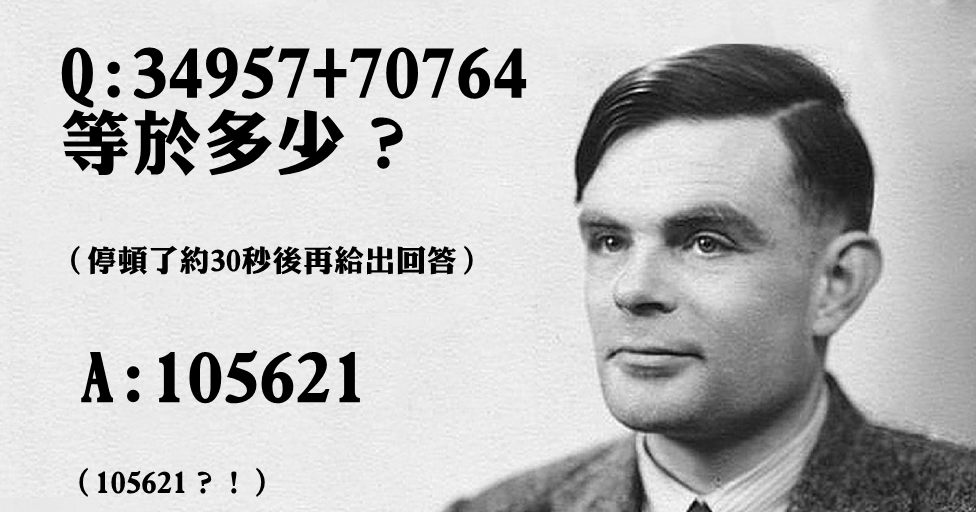

Q:34957 +70764等於多少?

A:(停頓了約30秒後再給出答案)105621。

Q:你會下西洋棋嗎?

A:會。

Q:我在K1 處有一個王,除此之外沒有棋子了。你在K6 處有一個王且在R1 處有一個車。現在由你走,你會怎樣走?

A:(15 秒停頓後) 將車移動到R8,然後「將軍」。

在這個交流中,計算機器是犯了一個運算錯誤。那兩個數相加的結果其實是105,721,而不是105,621。身為出色的數學家的圖靈不大可能會意外留下這個錯誤。這個更有可能是一個彩蛋,目的是想提醒讀者。

圖靈似乎在文章的其他地方提出,這種算錯數其實是一種程式編輯上的花招,是騙過裁判的一種手段。圖靈知道,對電腦回應研究仔細的讀者會發現這個錯誤,然後認為只有人才會犯這種錯誤,而機器不會犯這麼低級的算術錯誤。圖靈寫道:「機器可以故意引入計算錯誤來迷惑質問者。」

儘管利用錯誤來給出這是「人類智慧」的暗示在1950年的時候很難理解,但這已經成為致力於自然語言處理的程式設計師的一種設計實踐。比方說,2014年6月,一個叫做Eugene Goostman的聊天機器人據說已經成為第一個通過圖靈測試的電腦。但批評者很快指出,Eugene之所以能通過測試是因為一項內建的作弊手段:Eugene模仿的是一個英語為第二語言的13歲男孩。這意味著他的語法錯誤和不完備的知識會被誤認為天真無邪和不成熟,而不是自然語言處理能力的缺陷。

類似地,在Google的語音助理系統,Duplex,去年也用擬人的嗯、啊等向群眾示好,很多人指出這並不是系統所做出的真正思考,而是人工程式編輯出來的遲疑來模仿人類的認知。

這兩種情況都是圖靈的想法,即電腦可以設計成犯一些簡單的錯誤來給人留下「對方是人」的印象。就像圖靈一樣,Eugene Goostman和Duplex的程式設計師也知道,在人類的易錯性方面進行膚淺的偽裝就足以騙過我們。

也許圖靈測試要評估的並不是機器是否有智慧,而是我們是否願意接受它是智慧的。正如圖靈自己所說那樣:「智慧這個概念本身就是情感而不是運算。我們認為某個東西行為的智慧程度如何,既取決於我們自己的心理狀態與訓練情況,也取決於該對象的自身屬性,二者的決定程度是一樣的。」圖靈似乎認為,也許智慧並不是一種可以程式編輯進機器的物質,相反,而是一種透過社會互動構造的才能。

請注意!留言要自負法律責任,相關案例層出不窮,請慎重發文!